AIGC重点关注两个方面,一个是AIGC的程度,另外一个是AIGC的落地场景。

11月3日,嘉程创业流水席第157席【探讨游戏科技趋势中AIGC应用】,邀请了遇见森林CEO郑国俊来分享,主题是《AIGC技术如何赋能IP角色内容创作》。

以下为郑国俊在嘉程创业流水席分享的内容:

我今天分享是大家比较关注的AIGC两个方面,一个是AIGC的程度,另外一个是AIGC的落地场景。

遇见森林从2020年开始,就非常关注AIGC,我们一直关注大的通用型模型,能在未来有什么应用。对我们来说,我们非常关注虚拟角色。我们团队是一个非常二次元的团队,一直在寻求如何把最喜欢的二次元角色,复活到无论是物理世界和虚拟世界中。

当主角团们遭遇了走廊尽头突然出现的双胞胎女孩,浴室里快速腐朽的全裸女人才意识到自己真实的来到了《闪灵》这个恐怖电影世界。比起隔着屏幕观看,当观众自己置身于电梯间喷涌而出的血海,面对砸破木门的铁斧和背后怨灵的穷追不舍时,才能真正唤起人们对于死亡的恐惧。

我们认为这种完全沉浸式的全真电影院体验才是未来虚拟世界的范本。而想要打造一个这样能让观众有沉浸感并且能够让他们花几天甚至是几个月几年的时间去持续体验的场景,我们需要近乎无限的故事内容。而这些故事的核心,是各种个性鲜明、拥有自己背景故事且可互动的虚拟角色。

所以我们希望能够借助AI的能力,打造能与人们真正建立长期情感关系的虚拟角色。比如图里是我非常喜欢的一个角色——露西,角色来自一部叫《Wolves in the Walls》(即《墙里的狼》)的VR电影。时长只有短短30分钟,但其制作成本却要上千万美元。

在这部VR电影里,观众能够带上Ocuslus头盔,来扮演露西想象中的朋友,进入她的世界里和她进行一场与墙里的狼进行斗争的冒险。在电影里你能跟她一起在里面画画,能跟她一起在里面拍照,能够跟她一起打败可恶的狼。观众和露西的每次互动,一起经历的每一个场景,都让观众和她建立起非常强的情感关系。唯一遗憾的是,观众和露西的旅程只有短短30分钟,因为每多一分钟互动的制作成本都是百万美元起跳。

其实这也说明了,为什么当我们进入到今天大多数3D虚拟空间里面,还是觉得整个体验非常地枯燥无聊,甚至非常重复,因为今天的角色内容制作成本其实是非常高的,你光是3D建模,比如说原神,一个角色光是从整个建模到后期的动画,可能要花超过100万人民币一个人。所以今天在讲3D的内容投入时,会非常的慎重。

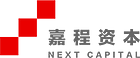

如果我们退一步从成熟的工业制作流程来看待角色创作,会发现今天大家围绕角色所做的内容可以分为1D到4D,而我们团队一直在实践和探索的就是如何利用AI生成的能力去赋能每一个环节。

但在今天,我们其实面临着一个非常枯燥无聊的元宇宙场景,而底层原因依旧是今天的3D内容制作效率太低,光是3D建模靠传统的制作效率就无法满足当前的3D内容需求。

那么,我们过去用AIGC从1D到2D到4D的过程当中,在每一个环节里面是怎么给IP角色赋能的呢?

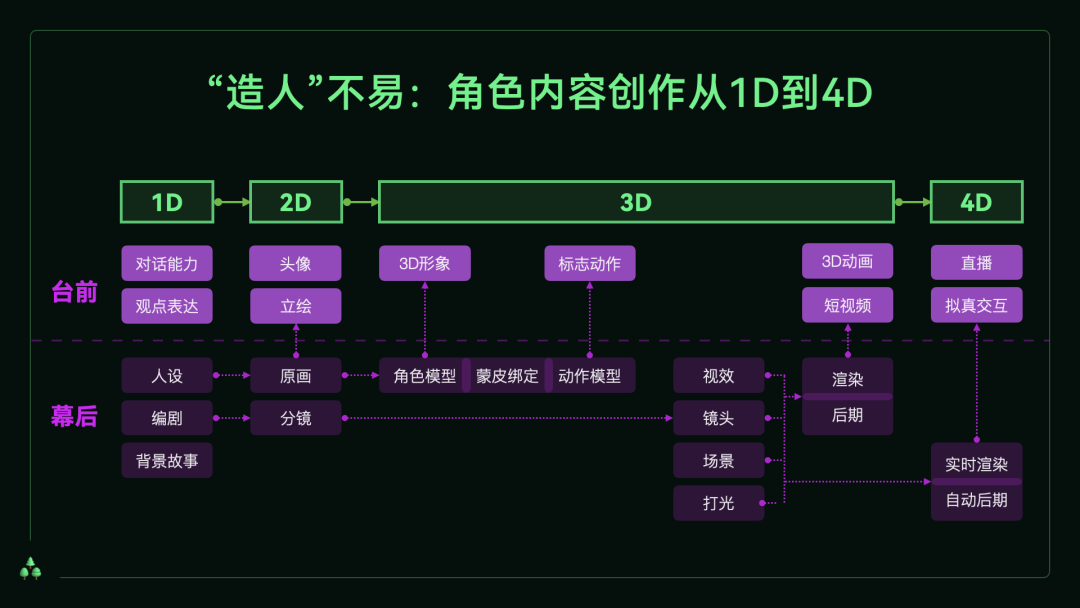

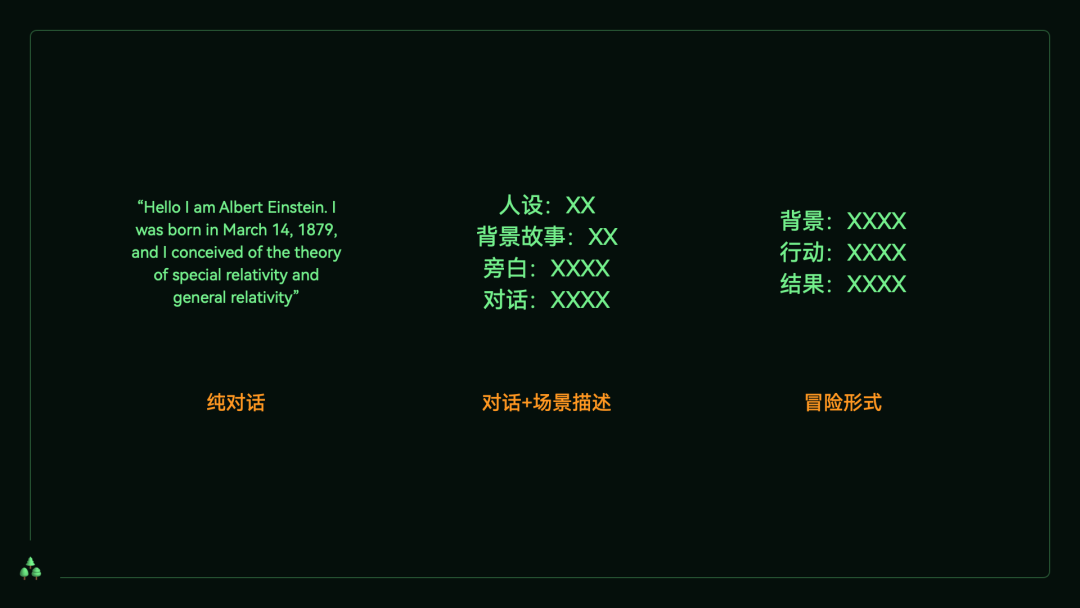

这里1D的角色内容其实是角色的对话能力。过去我们尝试说,当我们有了大规模语言模型之后,可以让这个角色能够跟人们进行一些更加自然连贯的对话,角色能够拥有记忆同时能够做出符合人设的反应。

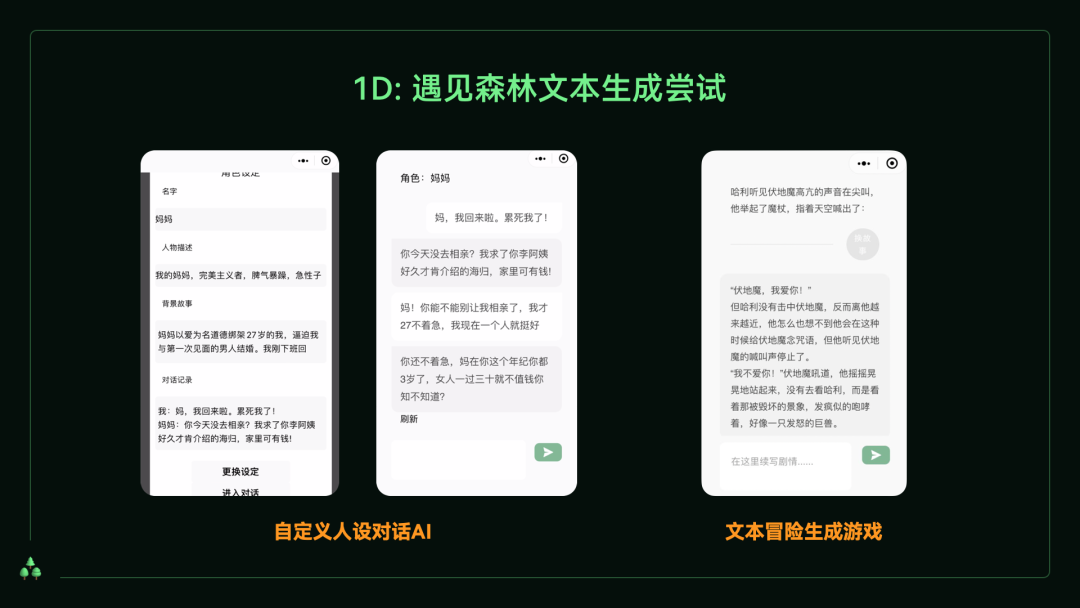

比如说像character.ai,用户能够自定义的人设对话,我可以把名字、人物描述以及它的背景故事,把它给输入进去之后,它在右边的这样子的一个对话,就能够生成出类似的符合人设的对话。

你把爱因斯坦的名字输入,然后从维基百科或者百度百科把爱因斯坦的简介复制粘贴进去。这时,后面的AI模型,它能够模拟出相对应的人物性格和说话风格。

今天利用这种能力我可以直接跟任何的一个历史人物进行对话交流,爱因斯坦也好,或者说莎士比亚,如果你这个学校里面的老师,今天想让孩子们开始学习某个著名的历史人物,就可以利用这样的工具让学生更了解这些人物。比如说:孩子们,如果我们今天读到这篇课文,我让你们跟历史上的人物进行一次对话,你们在课后可以回家使用这样的工具,明天课前我们再来讨论一下,今天和莎士比亚或者跟刘备或者曹操,某个这样的历史人物,跟他们对话比起课本内容你有什么不同的感受?你对这个人有什么新的认知?当你和这些历史人物深度交流后,你很有可能对于这样的人物you跟多不同的认知和印象。

所以比起过去那种枯燥的只是读课本,它其实对传统教育方式是很好的补充。当然它不仅限于此,你可以跟现实中的人物有更多互动和信息交换,比如你在甘肃你和喜欢的上海数字人老师进行进行一对一的互动,也可以和自己喜欢的角色,比如说原神的甘雨,或者是人们喜欢的某个二次元角色,都能够通过实时对话交互来和他们建立一个更加亲近的关系。

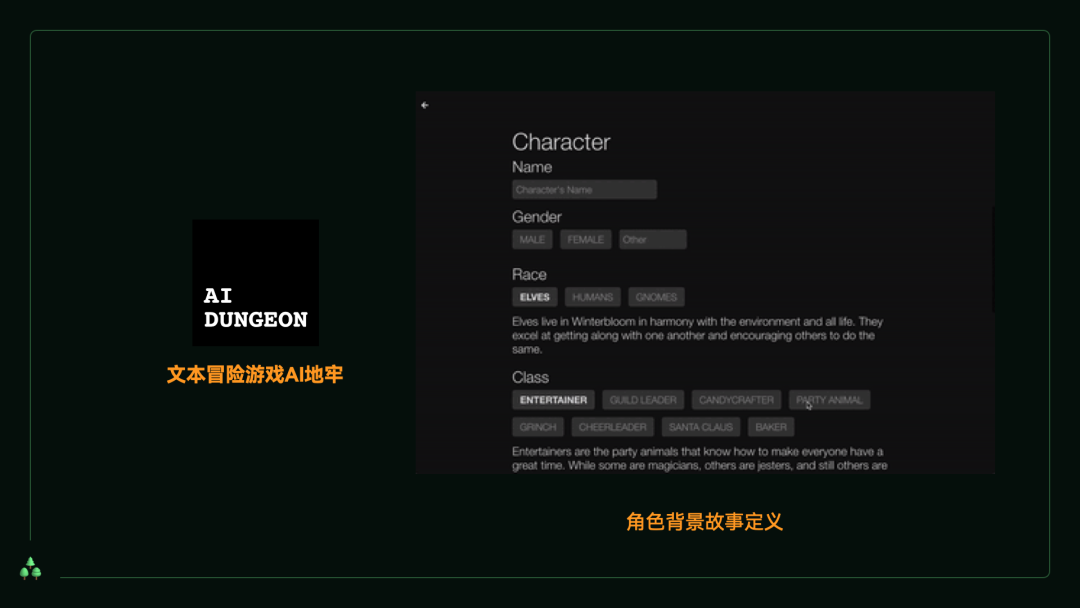

另一个有意思的usecase是AI Dungeon(AI地牢),你把一个角色的姓名,和他的性格,以及他是什么样的种族,可以是精灵,或者说是一个人族,你可以直接在里面进行调节,甚至自己输入,你就可以成为某个角色。基于这样的设定,你能够在相应的幻想世界无论是《魔戒》的中土世界还是末世丧尸世界扮演丧尸或者是多比还是反派大魔王去开启一段新的人生体验。当然它这里面非常不一样在于,你现在是扮演特定的角色在这里面这进行一场冒险。你可能在路途上遇到各种不同的角色,跟他们结伴出行,一起在这里面打怪,你可以在里面随时做出你的决策同时还能改变整个故事剧情的走向。

所以今天的所有的这种AIGC的能力,其实都是在用不同的方式,改变人和人,或者人和内容的交互体验。AIGC降低了角色创作门槛,人们可以同时是消费者和创作者,并获得全新的体验模式。

然后在模型训练方面,尤其是在往细分领域去做微调的时候,需要的训练数据集也会很不一样。当你想做像character.ai这样的一个角色对话的时候,我只是利用了大模型的通用泛的学习能力,我只是输入一个角色的背景故事,我就能够去生成后面所有的对话。更难的是像AI Dungeon模式的训练数据集,他们用的是Choose Your Own Adventure格式的数据集,这种数据集在今天的公开网络上比较难找到。

有一个事情是更加让我们坚定的,在未来的两到三年之内,随着模型的参数量增加,整个的所有的AIGC的这样的一个质量现在高几个量级,而且大模型的算力要求也会逐步下降,能够在更多行业有广泛的应用。在后面,我们就可以看到有更多的这些好玩的东西,好玩的结合,比如说结合文本的总结能力和图片生成能力去制作给小朋友的三国演义绘本或者是实时生成的galgame等等。

现在大家在做AIGC的时候,3D这块目前还是一个非常的前沿领域,因为它其实没有被攻克。

可以看到传统的3D内容制作流程的环节多,涉及的专业工种多,门槛是很高的。比如说3D形象,需要先有2D原画,在这基础上再在DAZ3D或者Blender等工具捏3D模型。当你有这样3D模型之后,你还需要经历蒙皮和骨骼绑定。如果你想要它做出各种各样比如说举手或者跑步动作,你需要像导演一样,需要精确到说这个人的抬手高度,什么表情,镜头和灯光该什么样,才能打造出一个非常艺术品的动作动画。

我们在过去几个月里和一些数字人公司合作过程中就发现,虽然他们让客户能把数字人低门槛地捏出来了,但到最后放到一个实际3D场景中,其实客户需要数字人动起来的。比如说游戏场景里面,我有数百个NPC,我需要他们都动起来,但因为现在的3D骨骼动作动画制作还是纯手工产业,就只能一套同样的走跑跳呼吸等骨骼动作给所有角色。

如果未来很多人都把自己的一些社交场景都搬到这样的robots的一个3D场景的时候,我们觉得是每个人无论是角色还是NPC都需要有一套属于自己的动作,就像你现实中走路的姿势就跟别人不一样,别人能通过你走路的姿势,或者说你自己打招呼的方式能够认出来你是谁,动作是人的生物特征之一。

这时候你本身来说,你每个人进去都应该有自己的一套所谓的跑、跳、走路、呼吸这些东西都是要有你自己独有的这种的动画内容。以今天的这种条件来说,如果都还是是外包,你要通过动画是一个个去手调,甚至你自己要去具备这样的一个专业的知识,这个很明显是不太可能实现的。如果这种大规模的deploy,一定要有新的AI辅助生成创作工具。

所以今天来说,我们自己是希望能够通过无论video也好,text也好,还是说像这种music也好,用户能够通过唾手可得各种数据像视频、音乐、文本等去生成自己独有的动作动画,让你在社交场景中能够更多表达自己。

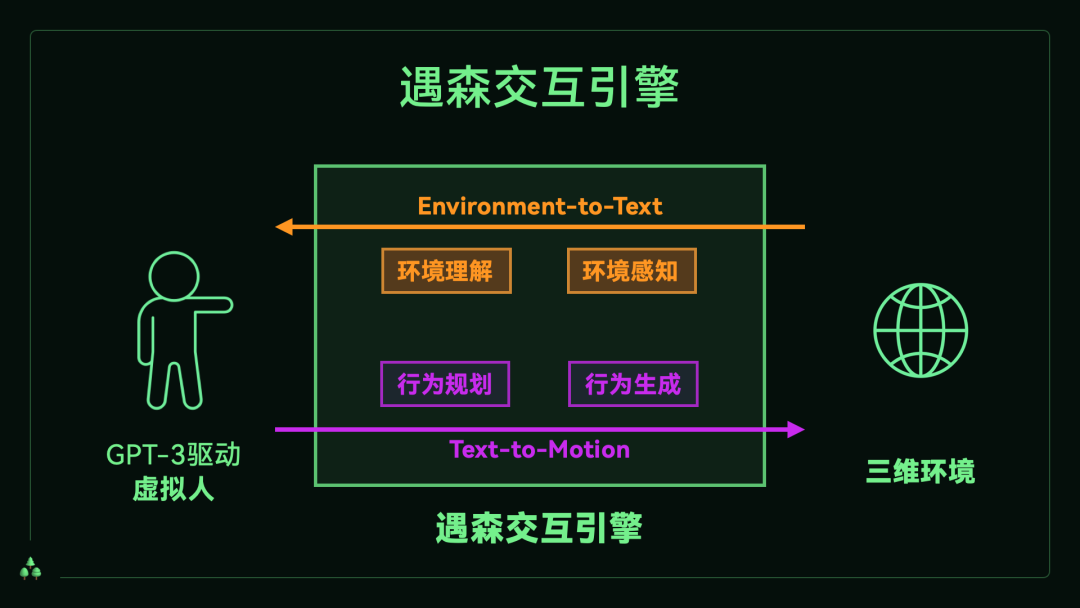

另一方面是新的交互形式的转变。当把一个角色放到了3D环境里面之后,交互方式会和我们人在线下的交互一样,比如Inworld AI在试图把人与角色在3D环境里的交互搬到各个游戏平台。

但我们人在线下是不会和我们微信聊天一样,走到一个人身边,你跟他突然开启一段对话,就只能是一对一。在真实的世界当中我们如何互动以及和谁互动都是很随机的,比如说我们在一个conference里面,或者是你在party里面,你跟一个人在交流的时候,可能就突然有个人对你们的话题感兴趣就参与进来,你这样子的一个交互的体验在今天这种2D的聊天框、微信式互动是体现不出的。

所以在今天其实我们就觉得,如果当我们把AIGC应用到一个3D环境的时候,还是在以过去的这种把2D的交互界面把它迁移过来,其实明显是不太make sense,在这过程当中一个AI虚拟人,它这个时候就必须要具备环境感知、环境理解,还有行为生成等能力。我们需要把各不同的AI能力去把它组合起来,才能够打造这样的一个体验。

这里其实也就涉及到4D内容了。4D其实指的是我们如何与角色实时3D交互,比如今天你可以通过虚拟人直播和他们进行实时交互,你也可以在VR或者3D环境里和角色进行拟真交互,这背后就要用到大量的自动后期和实时渲染能力。

我们当时是以《楚门的世界》为原型让用户能够通过一个摄像头来观察一个角色的日常生活,就像人们透过鱼缸观看金鱼一样,金鱼生活在自己的场景里并不知道外面有人在看它们那样体验。并且你能够通过发短信的形式一直不断去影响这个角色在这个世界里面行为,我们通过这个场景做了非常多3D交互中如何与AIGC进行结合的尝试。比如说在这个场景里就集合了骨骼动作生成,根据人设生成相应的AI对话以及3D模型生成等等。

我的分享就到这里,谢谢大家的时间~

嘉程创业流水席是嘉程资本为创业者打造的高端、私密、平等的社交平台。在这里,大家能遇到来自各领域的优秀同道中人。自2018年下半年推出嘉程创业流水席的服务以来,承蒙广大席友厚爱,通过线上社群、直播和线下活动、交流的形式,我们接连在北京、上海、杭州、深圳举办了150场创业者流水席,迄今已服务数万名创业者和行业人士,有近千位企业家和行业专家在嘉程创业流水席分享过行业观点。

往期嘉程创业流水席线上活动现场

往期嘉程创业流水席线下活动现场

嘉程资本Next Capital是一家专注科技领域的早期投资基金,我们极度信仰科技驱动的行业创新,希望成为创新者的第一笔钱,与极具潜力的未来商业领袖共同开启创新的未来。

我们的投资领域涵盖新消费、新技术、新医疗。投资案例包括熊猫速汇、多抓鱼、十荟团、拉面说、店匠、bosie、熊猫星厨、核桃编程、橄榄枝健康等多家创业公司的天使轮或早期阶段。

嘉程资本旗下的创投服务平台「嘉程创业流水席」,致力于为科技互联网创业者和行业人士提供深度链接和一手行业信息,迄今已服务数万名创业者,汇聚了数百个创业者社群,有近千位企业家与行业专家在嘉程创业流水席分享过行业观点。

嘉程资本创始合伙人李黎是知名天使投资人,曾主导投资过乐信(纳斯达克代码:LX)、团车(纳斯达克代码:TC)、老虎证券(纳斯达克代码:TIGR)、牛股王、蜜芽、辣妈帮、PingCAP、易订货、彩贝壳、鹿客、Krazybee等明星公司的天使轮。

嘉程资本是创业者思考的伙伴,成长的伙伴。

嘉程资本

握手未来商业领袖

BP 请发送至 BP@jiachengcap.com

微信ID:NextCap2017